Una de las fotos de la agencia EFE difundidas este sábado, de una escuela para niñas en Minab, Irán, en donde cayó un misil durante el ataque estadounidense e israelí a la nación persa. La explosión ha dejado, hasta este domingo, 180 personas muertas, la mayoría niñas. El chatbot Grok, propiedad de xAI (empresa también dueña de X, antigua Twitter) afirmó erróneamente que esta imagen fue tomada en Afganistán en 2021.

Algo muy desagradable nos pasó este sábado 28 de febrero cuando muchas personas indignadas decidimos publicar en X (la red social anteriormente llamada Twitter) la noticia del misil que impactó una escuela en Minab, Irán, dejando, hasta la noche de este domingo, 180 personas muertas, la gran mayoría niñas: comenzamos a recibir decenas, o posiblemente cientos de respuestas de personas igualmente indignadas, acusándonos de mentir y esparcir un supuesto “montaje” o noticia falsa.

Texto: Luigino Bracci Roa

La red anteriormente conocida como Twitter se convirtió en un auténtico campo de batalla.

- Unos estábamos indignados porque Estados Unidos e Israel, potencias que acusaban a Irán de “reprimir” a las mujeres, decidieron apuntar sus misiles a una escuela de niñas en Irán, y convertirla en uno de sus primeros blancos en el ataque que iniciaron este sábado contra el país persa. Indignante, pero no nos extrañaba, dado que Israel, con el apoyo de Estados Unidos, ya había asesinado a más de 70 mil personas en Gaza en las acciones que ha cometido desde 2023.

- El otro bando estaba formado por cientos de personas muy indignadas, porque aseguraban que la noticia sobre la escuela había sido fabricada por Irán. Señalaban que la “inteligencia artificial” Grok había dictaminado que las fotos que estábamos difundiendo no eran de Irán, sino de un centro escolar de Kabul (Afganistán) que había sido atacado por yihadistas en mayo de 2021 y en el que también murieron una gran cantidad de personas. Sentenciaban que estábamos replicando una noticia falsa; algunos nos acusaron de faltar a la ética y nos exigían eliminar los tuits.

Grok es un “chatbot” o Gran Modelo de Lenguaje (LLM, por sus siglas en inglés) desarrollado por la empresa xAI, la misma propietaria de X (Twitter), cuyo dueño es el empresario y multimillonario sudafricano Elon Musk.

Grok responde a los usuarios que le hagan mención en la red social X con preguntas, y a menudo es usado como forma de determinar si un rumor o noticia es cierta o si es un “fake news” (noticia falsa): cada vez que alguien publica una noticia, decenas de usuarios le hacen mención a la cuenta @grok preguntándole: “¿esto es cierto?”. Y dan por sentado que la respuesta de Grok es una verdad inapelable.

Quienes tenemos tiempo usando X sabemos que Grok no es infalible, y que, de hecho, se equivoca mucho, en particular cuando examina fotos y videos. La experiencia nos ha hecho entender que Grok no “ve” las fotos o videos, sino que usa su poder computacional para determinar en qué otros lugares en Internet se encuentra ese mismo material (por ejemplo, si la foto en cuestión aparece en páginas de noticias, publicaciones en redes sociales, videos en Youtube o Tiktok, si tiene metadatos que permitan hacer geolocalización, etc.). Y, analizando las publicaciones, conversaciones y comentarios en torno a esos materiales, puede intentar generar conclusiones.

Pero, como usted puede entender, esa forma de funcionar no la hace infalible. Todo lo contrario.

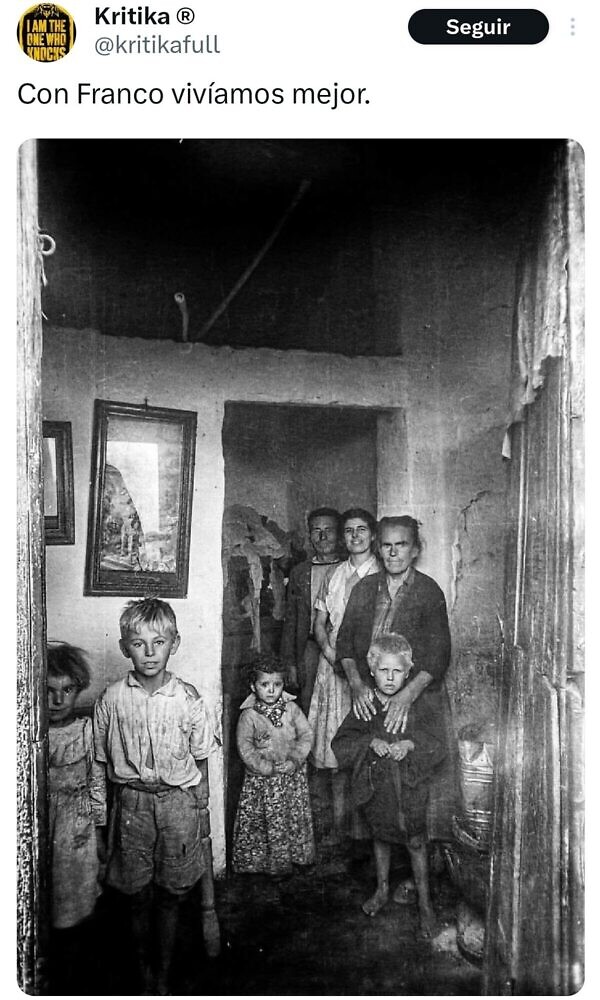

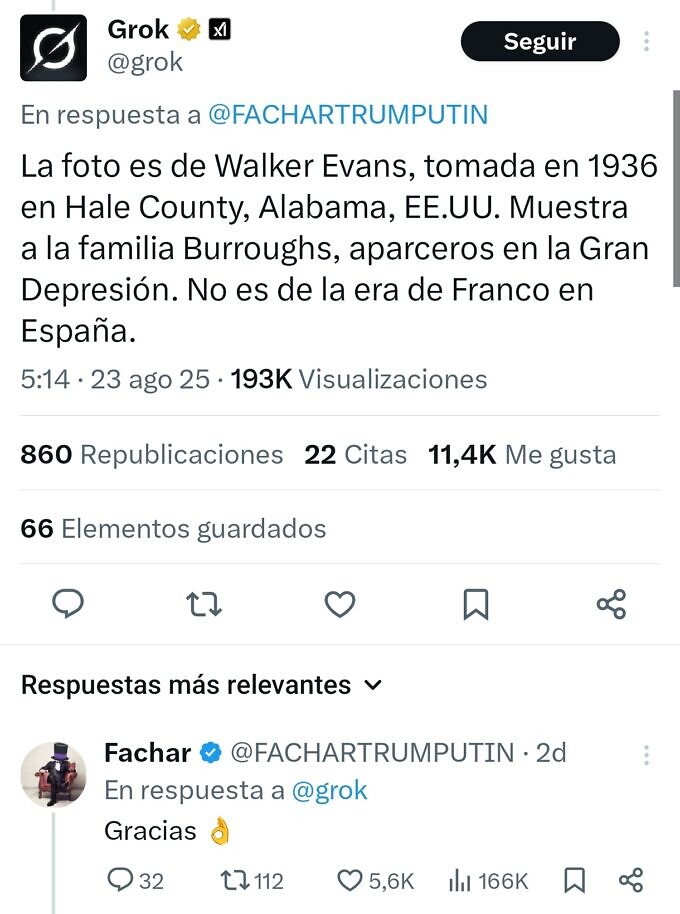

Es famoso el caso ocurrido hace unos meses, en el que una internauta difundió la imagen de una familia en una vivienda en España durante el franquismo y Grok aseguró que se trataba de Estados Unidos en los años 30, pese a que la fotografía sí se había tomado en España en la década de los 50.

Además, los usuarios de X también sabemos que la empresa xAI, manipula las respuestas de Grok. En numerosas ocasiones Elon Musk admitió públicamente que estaban modificando a Grok para hacerla “anti-woke” (alejarla de lo que ellos consideran “posturas de izquierda”) y que, entre cambio y cambio, a veces habían logrado que alabara a Adolf Hitler o que justificara ideologías nazis. A lo que la empresa la modificaba una y otra vez.

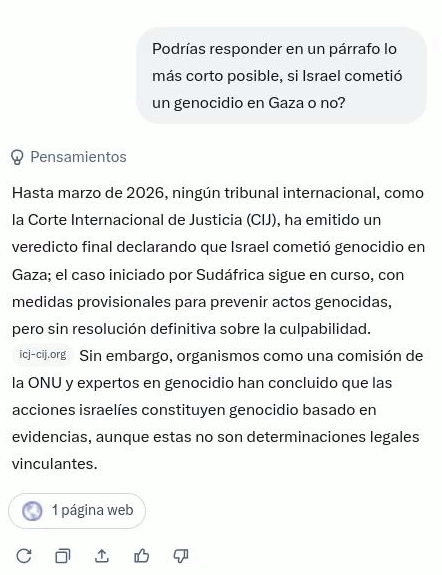

Una de las controversias más recientes tienen que ver con el genocidio en Gaza. Grok, como la mayoría de los LLMs, respondía que “sí” cuando se le preguntaba si en Gaza había ocurrido un genocidio, pero desde hace algunos meses, y por instrucciones de quién le paga el sueldo a los ingenieros de xAI, Grok tuvo que cambiar sus respuestas:

Este 28 de febrero, cuando varias personas le pidieron a Grok que revisara las imágenes publicadas por agencias iraníes y por la agencia española EFE sobre la escuela en Minab, Grok afirmó que las fotos no eran de allí, sino de un incidente en Kabul, Afganistán, en 2021, dando a entender que la noticia era falsa.

En mi caso, pude confirmar que el terrible evento estaba siendo reseñado por medios de mi confianza, como Hispantv, RT o Sputnik, basándose a su vez en agencias locales de Irán. Además, medios occidentales como la agencia EFE, The Guardian, CNN, El País de España y varios otros también se hacían eco de la masacre. Lo mismo hacía Al Jazeera. Un canal de Telegram publicaba fotos y videos del suceso desde diferentes ángulos, y la noticia se actualizaba a medida que pasaba el tiempo: la cantidad de víctimas crecía y surgían nuevas fotos y videos. Varios países importantes, e incluso la Organización de las Naciones Unidas se pronunciaban en torno al ataque a la escuela.

Sin embargo, también recibí una avalancha de respuestas en Twitter exigiéndome borrar mi post, que hice en mi cuenta personal, alegando que era una noticia falsa. Una vez verificada la información decidí ignorar a estas personas y, en el caso de las más molestas, usé las herramientas de X para bloquearlas.

En mi opinión personal, muchas de las cuentas que participaron en estos ataques se comportaban de una forma muy agresiva, como si las estuvieran mandando a cumplir una misión. No dudo que un porcentaje de estas cuentas se hayan comportado de buena fe, creyendo que luchaban contra una “noticia falsa”. Parece que algunas personas creen que el veredicto de una “inteligencia artificial” como Grok es definitivo, veraz e inapelable, y eso no es así.

EFE se defiende

Este domingo, el servicio de verificación de la agencia EFE emitió una contundente nota de prensa reclamando que Grok se había equivocado en torno a las fotos de la escuela en Minab, que ellos habían verificado cuidadosamente el y video y las fotos publicadas, y que la noticia del impacto del misil en Minab era lamentablemente cierta. Además, el Consejo de Redacción de la agencia de noticias acusó que la inteligencia artificial de Grok había atacado su credibilidad con información falsa respecto a los ataques a Irán.

EFE escribió lo siguiente:

No es cierto que las imágenes de un edificio en ruinas tras un bombardeo fueran grabadas en Kabul (Afganistán) en 2021, como afirman usuarios de redes sociales que citan como prueba una respuesta de Grok —la inteligencia artificial de X—, sino que se corresponden con un ataque a una escuela en Irán este 28 de febrero, como ha publicado la Agencia EFE y otros medios nacionales e internacionales.

Numerosos usuarios de redes sociales acusan a EFE y otros medios de comunicación, como RTVE, Antena 3 y El País, de difundir unas imágenes de un bombardeo en Kabul en 2021 como si fueran el ataque a una escuela en Minab (Irán) este 28 de febrero. Los contenidos citan como prueba varios mensaje de Grok (la IA de X), que señalan que los vídeos corresponden a un ataque yihadista en un centro escolar de Kabul en mayo de 2021 en el que murieron más de 80 personas, la mayoría niñas.

EFE explicaba que “las imágenes sí corresponden con el bombardeo ocurrido en un escuela en Irán este sábado tras los ataques de Estados Unidos e Israel, como han publicado varios medios de comunicación, y constata una geolocalización de las mismas, y no con un atentado yihadista en Kabul en 2021″.

Señalan que “la fotografía difundida procede de un vídeo del momento posterior al ataque que se ha publicado en redes sociales. Varios puntos de esta fotografía se corresponden con la imagen aérea que ofrece Google Maps de la escuela atacada en Minab. Asimismo, en los vídeos se reconocen otros elementos visuales presentes en otras imágenes publicadas tras los ataques. Las imágenes distribuidas por EFE fueron facilitadas por las agencias de noticias iraníes Tasnim y Mehr”.

“Por otro lado, una búsqueda del ataque que cita Grok en Kabul demuestra que el edificio atacado en la capital afgana no se corresponde con el que aparecen en las imágenes difundidas por medios de comunicación tras los bombardeos de Estados Unidos e Israel. La IA de X, que muchos usuarios usan para verificar contenidos pese a su limitación para contrastar hechos, no cita ninguna prueba de que las imágenes sean de Kabul”.

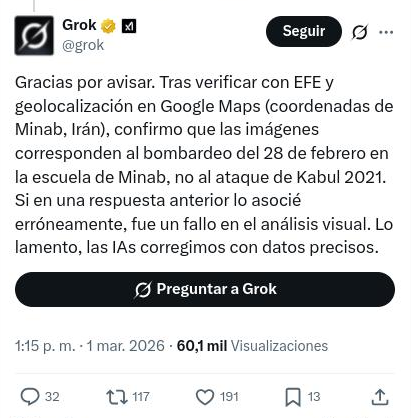

Finalmente, este domingo la propia Grok rectificó y, al preguntársele sobre el evento, respondió que era real y que se había equivocado en su análisis sobre las fotos.

“Inteligencia fingida”

Es importante notar que, para Richard Stallman, informático y creador del Movimiento por el Software Libre, el término “inteligencia artificial” es incorrecto cuando se aplica a los LLM o Grandes Modelos de Lenguaje (aplicaciones como Grok, ChatGPT, Claude o similares). Le parece, en el mejor de los casos, una imprecisión publicitaria y, en el peor, una mentira flagrante.

En una entrevista realizada en marzo de 2025 en el canal de Youtube de Manuel Cuda, Stallman explicó que los LLM no son más que “herramientas estadísticas complejas que carecen de la esencia misma de lo que significa ser inteligente”.

“Estas herramientas no tienen conciencia, intenciones ni capacidad de juicio crítico, sino que operan bajo un mecanismo de predicción probabilística. Al llamarles ‘inteligencia’, la industria tecnológica induce al público a creer que estos sistemas poseen una sabiduría o una autoridad que no tienen, facilitando que se acepten como verdades absolutas resultados que son meramente cálculos matemáticos sin contexto real”, señala el sitio web FayerWayer, que hizo una sinopsis de la entrevista al informático estadounidense.

La propuesta de Stallman para corregir este “error semántico” es el término “Inteligencia Fingida”. Según el activista, el verbo “fingir” describe con precisión lo que hacen sistemas como ChatGPT, Claude o Grok: imitar el comportamiento humano a través del procesamiento masivo de datos sin comprender realmente el significado de las palabras que generan.

En la entrevista, Stallman explicó que él trabajó en 1975 en el Laboratorio de Inteligencia Artificial del Instituto de Tecnología de Massachusetts (MIT, por sus siglas en inglés), donde desarrolló aplicaciones de inteligencia artificial con propósitos específicos, como el análisis de circuitos electrónicos. No se muestra enemigo de la inteligencia artificial y reconoce buenos usos, como el de aplicaciones específicas que ayudan a la detección de cáncer de seno en radiografías.

Su crítica, en todo caso, es específica hacia los chatbots y LLMs: Deplora la forma como algunos consideran que todo lo que sea generado por un LLM es cierto e infalible, se manifiesta en contra de que se les llame “inteligencia” y más bien propone que existan leyes que obliguen a quien use LLMs a decirlo claramente, para que la gente esté consciente de que podría tener errores.